Megatrend Künstliche Intelligenz: Was in Sachen Nachhaltigkeit bei acht großen Hoffnungsträgern wie Microsoft, Apple, Nvidia & Co. zu beachten ist

Künstliche Intelligenz ist ein Megatrend, der aus Anlegersicht hohe Wachstumschancen verspricht. Besonders hoch im Kurs stehen bei Investoren dabei Alphabet. Amgen, Apple, Meta Platforms. Microsoft, AMD. ASML und Nvidia. Das ändert aber nichts daran, das auch diese KI-Favoriten, ESG-Risiken ausgesetzt sind. In einem aktuellen Beitrag zeigt Morningstar auf, welche KI-Unternehmen in der Halbleiter- und Softwarebranche am besten in der Lage sind, künftige Nachhaltigkeits-Kontroversen zu vermeiden. TraderFox berichtet.

Künstliche Intelligenz (KI) kann laut Adam Fleck. Direktor für Forschung, Ratings und ESG bei Morningstar, ein mächtiges Werkzeug für Anleger sein, da sie dabei hilft, sich schnell über ein Thema zu informieren, Unmengen von Daten zu sichten und schneller als die meisten Menschen Vergleiche anzustellen.

Morningstar als ein führender Anbieter von unabhängigen Investment-Einsichten, bietet in dieser Hinsicht einen generativen Chatbot für KI namens "Mo" an. Angetrieben von der Morningstar Intelligence Engine, einer Plattform, die Morningstars umfangreiche Investment Research Bibliothek mit Microsofts Azure OpenAI Service verbindet, wurde Mo entwickelt, um Morningstars unabhängige Erkenntnisse in einem konversationellen Format für Investoren und Investment Professionals darzustellen und zusammenzufassen.

Losgelöst davon haben die Morningstar-Analysten die Halbleiterindustrie als einen Bereich hervorgehoben, der für KI-fokussierte Investoren interessant ist, und man hat dabei auch erörtert, wie KI ESG-fokussierten Investoren (Environmental, Social and Corporate Governance (ESG) (deutsch: Umwelt-, Sozial- und Regierungs-, Amts- oder Unternehmensführung) helfen bzw. sie behindern kann.

Wie das ESG-Risiko-Rating KI-Investoren hilft

KI ist dabei laut Fleck kein Allheilmittel. Sie birgt Gefahren in Bezug auf Umwelt, Gesellschaft und Unternehmensführung. Um diese Risiken besser zu verstehen, könne man das ESG-Risiko-Rating von Sustainalytics - und die darin enthaltene Managementkomponente - nutzen, um festzustellen, welche KI-Unternehmen in der Halbleiter- und Softwarebranche am besten in der Lage sind, künftige Kontroversen zu vermeiden.

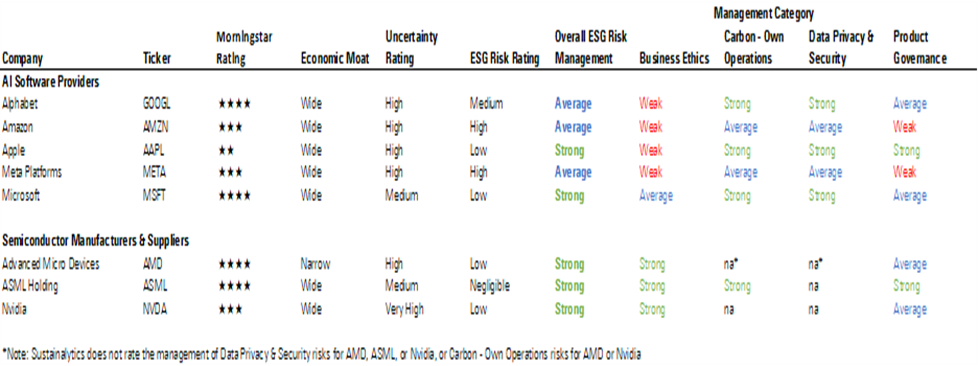

Insbesondere das Management mehrerer wesentlicher ESG-Themen (Material ESG Issues, MEIs) könne aufzeigen, welche Unternehmen am besten in der Lage sind, eine KI-basierte Zukunft erfolgreich zu meistern. Zu diesen wesentlichen Themen gehören Geschäftsethik, kohlenstoffintensiver Betrieb, Datenschutz und -sicherheit sowie Product Governance.

Unter der Berücksichtigung von Bewertungen, stellte Fleck nach eigenen Angaben fest, dass Microsoft, Advanced Micro Devices und ASML Holding an der Spitze der hausinternen KI-Chancenliste stehen, während Amazon.com und Meta Platforms ein höheres ESG-Risiko bei weniger attraktiven aktuellen Aktienkursen aufweisen.

Einige führende KI-Unternehmen haben ein besseres ESG-Management als andere

Hervorhebung der Bewertungen, der Wettbewerbsposition und des ESG-Risikomanagements von KI-exponierten Unternehmen.

Quellen: Morningstar, Sustainalytics. Daten vom 09. Oktober 2023.

Zur obenstehenden Tabelle sind gewisse Vorbehalte zu beachten, so Fleck. So handele es sich um Einschätzungen, nicht unbedingt um Vorhersagen. Außerdem mache KI nur einen sehr kleinen Teil des aktuellen Umsatzes dieser Unternehmen aus (und vielleicht auch ihrer zukünftigen kurzfristigen Einnahmen).

Dennoch sei es für KI-orientierte Investoren wichtig, die wichtigsten ESG-Risiken zu verstehen, mit denen diese Unternehmen konfrontiert seien, da das Potenzial bestehe, künftige Cashflows finanziell erheblich zu beeinträchtigen, wenn die Probleme nicht ordnungsgemäß bewältigt werden.

Die ESG-Risiken der KI, in ihren eigenen Worten

Wenn man jemanden kritisiert, scheint es nur fair zu sein, ihm die Möglichkeit zu geben, sich zu verteidigen. In diesem Fall konnte ich die KI direkt zu ihren ESG-Risiken befragen.

Der Bing-Chat (der die GPT-4-Technologie von OpenAI nutzt) leistet auf Nachfrage gute Arbeit, indem er mehrere wichtige ESG-Risiken der KI umreißt und auf relevante Artikel und Forschungsergebnisse verweist.

Frage: Was sind die ESG-Risiken der KI?

Antwort (über Bing Chat): KI-bezogene ESG-Risiken (Umwelt-, Sozial- und Governance-Risiken) sind ein wachsendes Problem. Hier sind einige der wichtigsten Risiken:

- Auswirkungen auf die Umwelt: KI-Systeme können aufgrund der hohen Rechenleistung, die zum Trainieren großer neuronaler Netze erforderlich ist, eine erhebliche Bedrohung für Nachhaltigkeitsziele darstellen. Der CO2-Fußabdruck, der durch die Speicherung und Verarbeitung von Daten entsteht, ist enorm und wächst weiter.

- Soziale Risiken: Es hat sich gezeigt, dass KI-Systeme möglicherweise die Ungleichheit zwischen den Rassen aufrechterhalten und demokratische Prozesse stören können. Es gibt auch Bedenken, ob Einzelpersonen von KI-Systemen fair behandelt werden oder ob bestehende gesellschaftliche Ungerechtigkeiten wiederholt oder sogar verstärkt werden.

- Governance-Risiken: Mangelnde Technologiekenntnisse sowohl in den Führungsetagen als auch in der Belegschaft können Unternehmen anfällig für Fehler machen. Fragen wie algorithmische Voreingenommenheit, Verdrängung von Arbeitsplätzen, Rechenschaftspflicht, Datenschutz und Zuverlässigkeit sind ebenfalls von großer Bedeutung.

Investoren und Unternehmen müssen sich bei der Implementierung von KI-Systemen dieser Risiken bewusst sein und sollten sich um verantwortungsvolle KI-Entwicklungs-, Beschaffungs- und Nutzungspraktiken bemühen.

Konzentration auf das Management der wichtigsten KI-Unternehmensrisiken

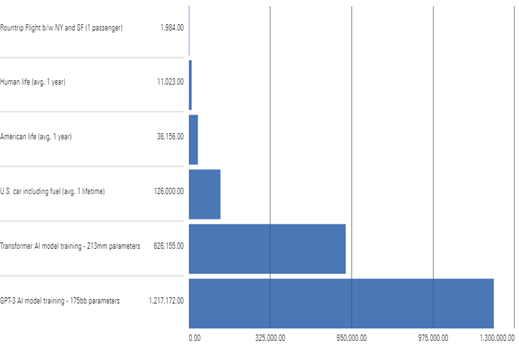

Umweltbelange im Zusammenhang mit KI stehen unter den von Bing angesprochenen dringenden ESG-Themen wohl an erster Stelle. Eine Studie des MIT aus dem Jahr 2019 ergab, dass das Training eines großen KI-Modells zu diesem Zeitpunkt beispielsweise fast fünfmal so viel Emissionen ausstoßen könnte wie ein durchschnittliches US-Auto. Und diese Zahl hat sich seitdem noch erhöht: Eine Studie aus dem Jahr 2021 schätzt, dass das Training von OpenAIs GPT-3 fast doppelt so kohlenstoffintensiv war.

Das Training von KI-Modellen ist sehr kohlenstoffintensiv.

Übliche Maßstäbe für den Kohlenstoff-Fußabdruck in Pfund CO2-Äquivalent

Quelle: Strubell, Emma et al. "Energy and Policy Considerations for Deep Learning in NLP" (2019); Patterson, David et al. "Carbon emissions and large neural network training." (2021).

Bing Chat weist aber auch auf soziale und Governance-Probleme hin, wie z. B. inhärente Voreingenommenheit, Verdrängung von Arbeitsplätzen und die notwendige Kontrolle durch die Führungsebene eines Unternehmens.

Die Managementkomponente der ESG-Risikobewertungen von Sustainalytics kann einen gewissen Einblick geben. Sustainalytics weist den Unternehmen schwache, durchschnittliche oder starke Managementbewertungen für bestimmte MEI zu. Für AI sind die relevantesten MEIs, die die oben genannten Themen abdecken, Geschäftsethik, Carbon-Own Operations und Product Governance.

Die Art und Weise, wie ein Unternehmen seinen Kohlenstoffausstoß verwaltet, ist angesichts der Energieintensität der KI-Entwicklung ein wichtiger Aspekt in unserem ursprünglichen Screening. Wie es seine Geschäftsethik handhabt, berücksichtigt die Führung durch den Vorstand und das Management in Bezug auf Themen wie geistiges Eigentum, wettbewerbswidriges Verhalten und Anreize zur Vermeidung unethischer Möglichkeiten. Und der MEI zur Produktgovernance konzentriert sich auf verschiedene Schlüsselaspekte der Produktsicherheit, einschließlich Fragen zu schlecht geführten Innovationen, die zu einer Diskrepanz zu den Kundenerwartungen führen könnten.

Natürlich beschränken sich die Bewertungen von Sustainalytics nicht nur auf künstliche Intelligenz. Aber Unternehmen, die die Best Practices für das Management dieser wesentlichen ESG-Themen befolgen, sind wohl am besten positioniert, um mit den relevanten Herausforderungen umzugehen, wenn die KI-Angebote weiter wachsen.

KI bedroht die Privatsphäre

Es gibt ein weiteres Hauptrisiko, das von Bing nur kurz erwähnt wird: Datenschutz und Datensicherheit. Da Verbraucher zunehmend KI-Tools wie die Verarbeitung natürlicher Sprache nutzen, sind der Datenschutz und die Sicherheit persönlich identifizierbarer Daten von größter Bedeutung.

Schließlich mag es akzeptabel sein, dass diese Informationen verwendet werden, wenn ein Smart-Home-Gerät auf der Grundlage des Suchverlaufs eines Nutzers eine verlockende Werbung anbietet, aber es ist aus der Sicht von Fleck problematischer, wenn Amazon die Stimmen von Kindern speichert oder Apple AAPL menschliche Transkriptoren für die zukünftige Entwicklung von Algorithmen verwendet. Datenschutzprobleme gehen auch über Einzelpersonen hinaus: Anfang dieses Jahres haben Samsung-Ingenieure versehentlich sensiblen Programmiercode an ChatGPT weitergegeben, als sie das Tool zur Fehlerprüfung verwendeten.

Zwar haben KI-Anbieter in den letzten Jahren viele dieser Bedenken ausgeräumt, z. B. stellt Apple keine Auftragnehmer mehr ein, die Siri-Gespräche abhören. Aber die Welt bewegt sich schnell. Für Unternehmen ohne angemessene Managementkontrollen kann es verlockend sein, die Datenschutzbedenken einzelner Nutzer im Namen der Innovation zu umgehen, befürchtet Fleck.

Diese Risiken haben aus seiner Warte auch Auswirkungen auf die reale Welt. Wie Morningstar im Vorjahr in einem Artikel festgestellt habe, würden die Kosten von Datenschutzverletzungen weiter ansteigen. Laut dem jüngsten Bericht des IBM/Ponemon Institute Cost of a Data Breach 2023 sind die Kosten pro Datenschutzverletzung auf 4,45 Millionen USD gestiegen, was einem Anstieg von 15,3 % gegenüber 2020 entspricht. Und die Aufsichtsbehörden werden sich wahrscheinlich weiterhin mit diesem Bereich befassen: Nach dem vorgeschlagenen EU-KI-Gesetz könnten Unternehmen, die gegen die Data-Governance-Bestimmungen verstoßen, mit Geldstrafen von bis zu 4 % des Umsatzes belegt werden.

Die gleiche IBM-Studie zeige, dass die durchschnittlichen Kosten einer Datenschutzverletzung für Unternehmen, die KI-Sicherheitslösungen einsetzen, um fast 20 % niedriger sind. Doch wie viele neue Technologien könne auch die künstliche Intelligenz ein zweischneidiges Schwert sein. Für langfristige Investoren in diesem Bereich ist es entscheidend, nicht nur die Chancen, sondern auch die wichtigsten ökologischen, sozialen und Governance-Risiken zu verstehen, so Fleck.

Bildherkunft: AdobeStock_471836352